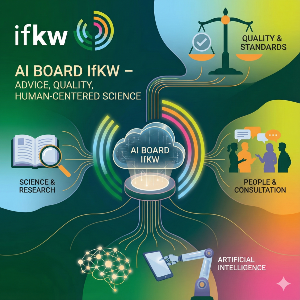

Das AI-Board des IfKW kurz vorgestellt

Künstliche Intelligenz prägt Forschung, Lehre und Verwaltung zunehmend – und wirft zugleich neue ethische, rechtliche und wissenschaftspraktische Fragen auf. Das AI-Board des Fachbereichs Medien und Kommunikation unterstützt Studierende, Lehrende und Forschende dabei, KI verantwortungsvoll, transparent und regelkonform einzusetzen. Die Empfehlungen des AIB basieren auf grundlegenden akademischen Prinzipien wie Autonomie, Verantwortung, Transparenz, Replizierbarkeit, Fairness und Diversität. Gleichzeitig berücksichtigt das Board die besonderen Herausforderungen von KI-Systemen – etwa mögliche Halluzinationen, Bias, fehlende Faktenprüfung oder Fragen der Datensicherheit.

Das AI-Board versteht sich als niedrigschwellige Anlaufstelle für alle Anliegen rund um KI-Nutzung: von didaktischen Fragen über die Entwicklung von Lehr- und Lernmaterialien bis hin zur Gestaltung von Forschungsprozessen oder zur Klärung von Regeln im Prüfungsbetrieb. Anfragen jeglicher Art können jederzeit an aib@ifkw.lmu.de gerichtet werden.

Richtlinien zum Einsatz von KI für Studium, Forschung und Lehre

Algorithmische Informationsverarbeitung gehört zum Arbeits-, Lern- und Lehralltag. So nutzen Lehrende die neuen technischen Möglichkeiten für ihre Seminar- und Vorlesungsplanung. Dazu gehört auch, den Umgang mit algorithmus- und sprachmodellbasierten digitalen Agenten zu schulen, Studierende zu sensibilisieren und zum Umgang zu befähigen. Deswegen dürfen am IfKW Studierende KI für ihr Studium nutzen – allerdings nur unter klaren Regeln, die dem Schutz wissenschaftlicher Integrität dienen.

Orientierungspunkte